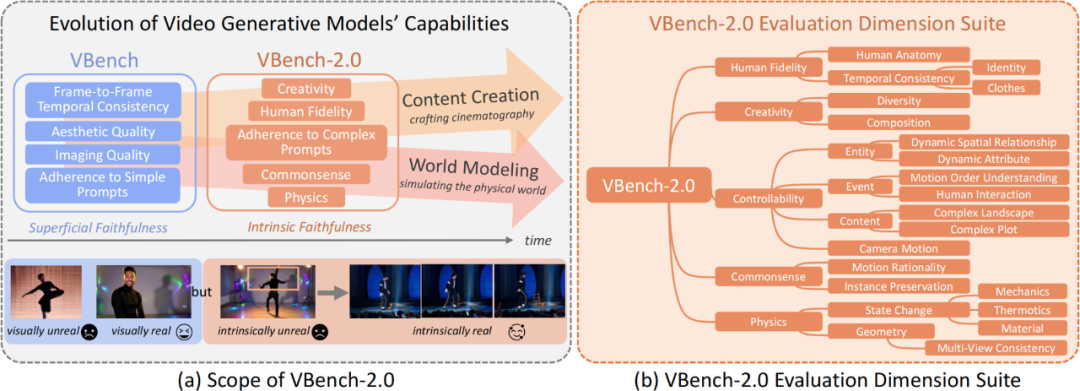

去年,AI视频生成技术发展迅速。自从Sora于2024年初发布以来,每个人都震惊地看到AI可以制作现实的视频。一段时间以来,主要的大学实验室,互联网巨头AI和初创公司进入了视频生成领域。在视觉效果方面,封闭的资源模型(例如Kling,Gen,Pika)是惊人的。最近,Hunyuanvideo和Wanx等完全开放的资源模型在VBench列表中表现出色,这使我们能够看到社区在促进现代技术方面的无限潜力。但是,当每个人都说“视觉效果令人惊叹”时,新想法不可避免地会出现:我们应该在哪里遵循视频的生成?忠诚对别人意味着一切吗?发现其他更深层次的功能值得挖掘?从“表面真实性”到“内部真实性”,作为强大的视频和工业审查系统,第一个代理Vbench着重于Visual对视频的了解,例如每个帧的清晰度,帧之间的平稳连接以及视频和文本描述之间的基本交互。这些元素(也称为肤浅的忠诚度)解决了视频看起来是否现实以及看起来不错的问题,并为当前模型提供了单个测量大小。但是,为了创建一个真正切换到更高级别的应用程序的视频生成,例如制作AI辅助胶片,复杂的场景模拟等。只有能够遵守现实世界规则的模型,才能在长长的绘图,复杂的动作和内容创建中具有更大的潜力。 VBENCH-2.0:朝着“内部真实性”迈进,排除视频生成技术从表面现实到内部现实的技术,Nanyang Technology University S-LAB和上海人工智能实验室共同推出了VBENCH-2.0。纸张标题:VBENCH-2.0:视频进步生成长凳内在忠诚纸链接链接:https://arxiv.org/abs/2503.21755视频:https://www.youtube.com/watch? https://github.com/vchitect/vbench-2.0-project继承Vbench-1.0,请注意“真实表面”,VBENCH-2.0强调以下审查的基本依据:人类忠诚度(人类运动和结构)是否会在体育函数上进行触发的运动,而不是在运动过程中进行派上的运动,而不是在运动中相互关联,那么它是一种派生的指标,是一种常见的表现,是否是派上的,这是一种常见的表现。创造力在场景组合和故事情节扩展方面观察了模型的想象力。愉悦,重力和碰撞的影响是否有意义?该模型可以在场景中开发符合物理定律的动作或场景吗?常识性(常识性推理)在日常情况或逻辑引用中表现出合理性,好像食物确实进入了M在“进食”时,如果角色行为不寻常,则Vbench-2.0提出了大量的精制评论和对上述技术的自动评论,包??括在特定领域(检测人体身体异常运动)执行的一般多模型模型(VLMS,LLMS)和“专家”方法。为了确保测试结果的可靠性,我们与人类标记的真实结果进行了很大的比较,试图进行自动评估,与直觉人类的判断一致。与人类视觉感知多视图观察一致的分层和脱钩的开源提示列表系统的18个尺寸有助于下一代视频制作。在以下网民经常批评的情况下,该模型经常揭示“内部真实性”的缺点。 VBENCH-2.0可以系统地判断网民一直批评的这些一代模型的缺陷,这是准确的!vbench评估N系统:两把剑的组合,具有更全面的VBENCH-1.0范围:适用于视频发电的“表面真实性”,例如视觉质量,文本匹配和整体效率。在此阶段,为促进各种模型提供了强有力的支持。 VBENCH-2.0:在保持VBENCH-1.0的好处时,进一步关注视频的“内部真实性”。如果我们想真正判断模型是否具有“世界模型”,并且是否可以在更深的创意情况和应用中使用,则VBENCH-2.0审查尤其重要。我们建议研究人员使用VBENCH-1.0和VBENCH-2.0来评估模型:前者可以直观地测量视频的视觉效果和基本一致性,而后者则探索了模型在物理,常识和复杂行为等模efields上的性能,这可以帮助您更好地了解模型的实际潜力。现有的模型性能:两种开放资源封闭的资源在VBENCH-2.0上具有不同AI视频生成模型的性能重点。在雷达图中,为了进行更清晰的视觉比较,我们将每个尺寸的测试结果标准化为0.3和0.8。 VBENCH-2.0模型的视频性能生成的各种模型。在审查VBENCH-2.0的“内部真实性”时,没有明确的“开放资源或封闭资源可以充分利益”的现象。在复杂情况下,许多社区资源项目的表现并不比商业封闭的资源模型差,这表明他完全有可能依靠社区共同建设。绝对开放的资源,欢迎加入社区聚集在一起,以促进视频新的Future Vbench-2.0是完全开放的资源,使您可以轻松地尝试比较兴趣模型。我们还期待着您对实际使用的评论和建议,并共同促进了TH的增长和演变E AI发电生态系统。我们还打开了一系列提示列表:https://github.com/vchitect/vbench/tree/master/master/vbench-2.0/prompts左侧的单词云显示了我们即时套件的单词分布的高频,右图显示了不同尺寸的信号数量。如果您是模型开发人员,应用程序开发人员或有兴趣切割技术的粉丝,欢迎您加入Thewe并探索视频一代从“看起来真实”到“ Essential”的奇妙演变。让我们一起工作,使下一代视频生成模型更具想象力,更接近现实世界! VBENCH-2.0准确吗?对于每个量表,我们计算VBENCH-2.0审查结果与分析的手动结果之间的相关性,然后证明了我们的方法和人类理解之间的一致性。在下图中,水平轴代表variou中手动检查的结果s尺寸,而垂直轴显示了VBENCH-2.0程序的自动评估结果。可以看出,我们的方法与人类对每个大小的理解完全一致。带给视频生成Vbench -2.0的更多想法不仅允许您检查Mearning模型,而且更重要的是,您还可以在不同模型中发现各种可能的问题,从而为开发下一代生成模型提供了重要的见解。不同的需求,使用不同的模型来比较创造性的想象力:Sora想要产生与人有关的镜头:Hunyuanvideo或Kling 1.6想要获得准确的相机控制:Kling 1.6想要模拟基本物理法律:是否有COGIDEOX-1.5的全能模型?敬请期待2025年和2026年的发展浪潮。角色的主要动作和变化仍然是缺点。我们发现,在非常简单的运动或特征变化中,所有mODELS的结果很差,表明训练数据的流动模型并未清楚地包括诸如位置和特征变化之类的文本。这可能是视频字幕模型功能的缺陷。可能的解决方案包括:在XI的直接单词或上下文中学习,以提示手动添加此类文本级别的一部分视频字幕模型,该文本级别的文本级别需要损坏。现在,主要视频的一代时间通常只是几秒钟,但是在将来,在电影和动画等较长的场景中,如何保持轮廓的统一是一个主要的挑战。当前的模型不支持故事级别的视频生成(连续5个小图)。主要原因是当前视频生成模型的持续时间仍处于5-10秒的水平,这是Farin的故事的故事。这将是未来内容和电影创作的非常重要的能力。平衡的Text Optimizer(提示炼油厂)具有创建文本的优化器有助于改善视频与描述的准确对齐,但也可以抑制不同的模型输出。如何平衡高质量和高创造力应与研究人员进行深入讨论。现在,高级模型使用文本优化器来稳定或感谢用户的文本输入。但是我们发现,使用文本优化器将在一定程度上提高生成视频的视觉质量,更接近文本描述。但这将在一定程度上影响世代的差异和创造力。因此,如果您想制作视频的文本风格差异很大,请杀死它,如果可以关闭文本优化器;如果您想要适合文本的视频的质量更高,那么使用文本优化器就是一个更好的选择。对于研究人员而言,如何构建可以改善视频质量而不影响其创造力的优化器是一个挑战。从表面到克恩El,对某些模型的演示的全面回顾很酷,但是在物理,逻辑识别或叙述中仍然存在缺点。正如VBENCH-2.0强调“内部真实性”的那样,我们无法基于第一印象做出快速结论。观看视频时表面的真实性(例如摄影)是第一印象,这就是为什么这么多人与高审美评级的功能和具有出色模型的高流体相关的原因。但是,这并不总是发生。内部真实性(例如讲故事能力,世界模拟能力)是确定视频生成模型是否可以在未来应用于真实场景的主要因素。例如,Cogvideox在VBENCH中没有获得最高的视频质量,并且视觉体验可能不如过去一个或两个月的新型号那样强,但是在许多Vbench-2.0的维度上,它的表现良好,侧重于内在忠诚度。可以看出,看演示只有足够的时间才能真正评估视频生成模型的全部功能和潜力。 VBENCH-2.0指导我们从更广泛的角度理解和衡量模型。我们真诚地邀请Lresearcher和开发人员对视频生成领域感兴趣,以参与VBENCH系统评论(VBENCH-1.0和VBENCH-2.0),并探索它以寻找视频生成,从“看起来真实”转向“ Essential”。让我们一起努力,推动下一代视频生成模型同时在地面和内核上蓬勃发展。

去年,AI视频生成技术发展迅速。自从Sora于2024年初发布以来,每个人都震惊地看到AI可以制作现实的视频。一段时间以来,主要的大学实验室,互联网巨头AI和初创公司进入了视频生成领域。在视觉效果方面,封闭的资源模型(例如Kling,Gen,Pika)是惊人的。最近,Hunyuanvideo和Wanx等完全开放的资源模型在VBench列表中表现出色,这使我们能够看到社区在促进现代技术方面的无限潜力。但是,当每个人都说“视觉效果令人惊叹”时,新想法不可避免地会出现:我们应该在哪里遵循视频的生成?忠诚对别人意味着一切吗?发现其他更深层次的功能值得挖掘?从“表面真实性”到“内部真实性”,作为强大的视频和工业审查系统,第一个代理Vbench着重于Visual对视频的了解,例如每个帧的清晰度,帧之间的平稳连接以及视频和文本描述之间的基本交互。这些元素(也称为肤浅的忠诚度)解决了视频看起来是否现实以及看起来不错的问题,并为当前模型提供了单个测量大小。但是,为了创建一个真正切换到更高级别的应用程序的视频生成,例如制作AI辅助胶片,复杂的场景模拟等。只有能够遵守现实世界规则的模型,才能在长长的绘图,复杂的动作和内容创建中具有更大的潜力。 VBENCH-2.0:朝着“内部真实性”迈进,排除视频生成技术从表面现实到内部现实的技术,Nanyang Technology University S-LAB和上海人工智能实验室共同推出了VBENCH-2.0。纸张标题:VBENCH-2.0:视频进步生成长凳内在忠诚纸链接链接:https://arxiv.org/abs/2503.21755视频:https://www.youtube.com/watch? https://github.com/vchitect/vbench-2.0-project继承Vbench-1.0,请注意“真实表面”,VBENCH-2.0强调以下审查的基本依据:人类忠诚度(人类运动和结构)是否会在体育函数上进行触发的运动,而不是在运动过程中进行派上的运动,而不是在运动中相互关联,那么它是一种派生的指标,是一种常见的表现,是否是派上的,这是一种常见的表现。创造力在场景组合和故事情节扩展方面观察了模型的想象力。愉悦,重力和碰撞的影响是否有意义?该模型可以在场景中开发符合物理定律的动作或场景吗?常识性(常识性推理)在日常情况或逻辑引用中表现出合理性,好像食物确实进入了M在“进食”时,如果角色行为不寻常,则Vbench-2.0提出了大量的精制评论和对上述技术的自动评论,包??括在特定领域(检测人体身体异常运动)执行的一般多模型模型(VLMS,LLMS)和“专家”方法。为了确保测试结果的可靠性,我们与人类标记的真实结果进行了很大的比较,试图进行自动评估,与直觉人类的判断一致。与人类视觉感知多视图观察一致的分层和脱钩的开源提示列表系统的18个尺寸有助于下一代视频制作。在以下网民经常批评的情况下,该模型经常揭示“内部真实性”的缺点。 VBENCH-2.0可以系统地判断网民一直批评的这些一代模型的缺陷,这是准确的!vbench评估N系统:两把剑的组合,具有更全面的VBENCH-1.0范围:适用于视频发电的“表面真实性”,例如视觉质量,文本匹配和整体效率。在此阶段,为促进各种模型提供了强有力的支持。 VBENCH-2.0:在保持VBENCH-1.0的好处时,进一步关注视频的“内部真实性”。如果我们想真正判断模型是否具有“世界模型”,并且是否可以在更深的创意情况和应用中使用,则VBENCH-2.0审查尤其重要。我们建议研究人员使用VBENCH-1.0和VBENCH-2.0来评估模型:前者可以直观地测量视频的视觉效果和基本一致性,而后者则探索了模型在物理,常识和复杂行为等模efields上的性能,这可以帮助您更好地了解模型的实际潜力。现有的模型性能:两种开放资源封闭的资源在VBENCH-2.0上具有不同AI视频生成模型的性能重点。在雷达图中,为了进行更清晰的视觉比较,我们将每个尺寸的测试结果标准化为0.3和0.8。 VBENCH-2.0模型的视频性能生成的各种模型。在审查VBENCH-2.0的“内部真实性”时,没有明确的“开放资源或封闭资源可以充分利益”的现象。在复杂情况下,许多社区资源项目的表现并不比商业封闭的资源模型差,这表明他完全有可能依靠社区共同建设。绝对开放的资源,欢迎加入社区聚集在一起,以促进视频新的Future Vbench-2.0是完全开放的资源,使您可以轻松地尝试比较兴趣模型。我们还期待着您对实际使用的评论和建议,并共同促进了TH的增长和演变E AI发电生态系统。我们还打开了一系列提示列表:https://github.com/vchitect/vbench/tree/master/master/vbench-2.0/prompts左侧的单词云显示了我们即时套件的单词分布的高频,右图显示了不同尺寸的信号数量。如果您是模型开发人员,应用程序开发人员或有兴趣切割技术的粉丝,欢迎您加入Thewe并探索视频一代从“看起来真实”到“ Essential”的奇妙演变。让我们一起工作,使下一代视频生成模型更具想象力,更接近现实世界! VBENCH-2.0准确吗?对于每个量表,我们计算VBENCH-2.0审查结果与分析的手动结果之间的相关性,然后证明了我们的方法和人类理解之间的一致性。在下图中,水平轴代表variou中手动检查的结果s尺寸,而垂直轴显示了VBENCH-2.0程序的自动评估结果。可以看出,我们的方法与人类对每个大小的理解完全一致。带给视频生成Vbench -2.0的更多想法不仅允许您检查Mearning模型,而且更重要的是,您还可以在不同模型中发现各种可能的问题,从而为开发下一代生成模型提供了重要的见解。不同的需求,使用不同的模型来比较创造性的想象力:Sora想要产生与人有关的镜头:Hunyuanvideo或Kling 1.6想要获得准确的相机控制:Kling 1.6想要模拟基本物理法律:是否有COGIDEOX-1.5的全能模型?敬请期待2025年和2026年的发展浪潮。角色的主要动作和变化仍然是缺点。我们发现,在非常简单的运动或特征变化中,所有mODELS的结果很差,表明训练数据的流动模型并未清楚地包括诸如位置和特征变化之类的文本。这可能是视频字幕模型功能的缺陷。可能的解决方案包括:在XI的直接单词或上下文中学习,以提示手动添加此类文本级别的一部分视频字幕模型,该文本级别的文本级别需要损坏。现在,主要视频的一代时间通常只是几秒钟,但是在将来,在电影和动画等较长的场景中,如何保持轮廓的统一是一个主要的挑战。当前的模型不支持故事级别的视频生成(连续5个小图)。主要原因是当前视频生成模型的持续时间仍处于5-10秒的水平,这是Farin的故事的故事。这将是未来内容和电影创作的非常重要的能力。平衡的Text Optimizer(提示炼油厂)具有创建文本的优化器有助于改善视频与描述的准确对齐,但也可以抑制不同的模型输出。如何平衡高质量和高创造力应与研究人员进行深入讨论。现在,高级模型使用文本优化器来稳定或感谢用户的文本输入。但是我们发现,使用文本优化器将在一定程度上提高生成视频的视觉质量,更接近文本描述。但这将在一定程度上影响世代的差异和创造力。因此,如果您想制作视频的文本风格差异很大,请杀死它,如果可以关闭文本优化器;如果您想要适合文本的视频的质量更高,那么使用文本优化器就是一个更好的选择。对于研究人员而言,如何构建可以改善视频质量而不影响其创造力的优化器是一个挑战。从表面到克恩El,对某些模型的演示的全面回顾很酷,但是在物理,逻辑识别或叙述中仍然存在缺点。正如VBENCH-2.0强调“内部真实性”的那样,我们无法基于第一印象做出快速结论。观看视频时表面的真实性(例如摄影)是第一印象,这就是为什么这么多人与高审美评级的功能和具有出色模型的高流体相关的原因。但是,这并不总是发生。内部真实性(例如讲故事能力,世界模拟能力)是确定视频生成模型是否可以在未来应用于真实场景的主要因素。例如,Cogvideox在VBENCH中没有获得最高的视频质量,并且视觉体验可能不如过去一个或两个月的新型号那样强,但是在许多Vbench-2.0的维度上,它的表现良好,侧重于内在忠诚度。可以看出,看演示只有足够的时间才能真正评估视频生成模型的全部功能和潜力。 VBENCH-2.0指导我们从更广泛的角度理解和衡量模型。我们真诚地邀请Lresearcher和开发人员对视频生成领域感兴趣,以参与VBENCH系统评论(VBENCH-1.0和VBENCH-2.0),并探索它以寻找视频生成,从“看起来真实”转向“ Essential”。让我们一起努力,推动下一代视频生成模型同时在地面和内核上蓬勃发展。

推荐文章

推荐文章